sharing is caring

ist wirklich so!

Vielen Dank fürs Teilen!

Kluge Köpfe filtern für dich relevante Beiträge aus dem Netz.

Entdecke handverlesene Artikel, Videos und Audios zu deinen Themen.

picker für: Technologie und Gesellschaft Fundstücke

Promovierte Literaturwissenschaftlerin. Schwerpunkte: Digitaler Journalismus, Journalistenausbildung und Medienkompetenz. Chefredakteurin der Berliner Gazette (https://berlinergazette.de) und Professorin für digitalen Journalismus an der Macromedia University of Applied Sciences. Kann sich die Namen ihrer Student*innen merken.

Was die Welt so ungerecht macht, lässt vielen von uns keine Ruhe. Warum gibt es Superreiche und zugleich superviele Arme? Wer sich bemüht, der Sache analytisch auf den Grund zu gehen, stößt früher oder später auf Herrschaftsmuster und -mechanismen. Formen von Dominanz kommen schließlich nicht aus dem Nichts. Und sie sind auch nicht gottgegeben. Die Rolle der Technologie in diesem Kontext ist hochpolitisch und umstritten. Doch der Mythos, dass Technologie "neutral" sei – etwa Elektrizität nur Elektrizität und kein Herrschaftsinstrument – hält sich ziemlich hartnäckig. Das gilt auch für Algorithmen.

Immer wieder heißt es, etwa im Feld der Gesichtserkennung oder Content-Moderation, Algorithmen seien neutral, objektiv und deshalb nicht nur verlässlicher, sondern auch fairer und gerechter als Menschen, wenn es um das Treffen von Entscheidungen und das Einordnen und Klassifizieren in "gut" und "weniger gut" (also: "schlecht") geht. In meinen piqs der letzten Jahre habe ich immer wieder Beispiele und Fälle vorgestellt, die das genaue Gegenteil beweisen. Algorithmen sind nicht neutral und objektiv. Sie werden von Menschen programmiert, die dabei wiederum auf von Menschen gemachte (sprich: sozial konstruierte) Kategorien zurückgreifen. Kurz und vereinfacht gesprochen: Die Ungerechtigkeit und Ungleichheit der analogen Welt wird ins Digitale übersetzt. Und dabei systematisch unsichtbar gemacht.

Ich habe diesen Diskurs bislang nicht unter einem bestimmten Begriff geführt. Wollte ich dafür einen Namen finden, so wäre dies vielleicht "linke Algorithmuskritik".

Linke Algorithmuskritik nimmt in den Blick, wie Ungerechtigkeit und Ungleichheit durch die digitale Welt nicht nur reproduziert, sondern auch multipliziert wird. Diskriminierung (Rassismus und Sexismus etwa) und soziale Kontrolle – das wären nur zwei Stichworte, die auf algorithmisch gestützte Herrschaftsmuster und -mechanismen verweisen.

Zu dieser Kritik gehört allerdings auch die Kritik an linker Algorithmuskritik (das verweist jetzt nicht auf die vielfach zitierte Tendenz innerhalb der Linken zur Selbstzerfleischung, sondern auf das aufklärerische Projekt linker Kritik, die sich gerade deshalb gesund und wachsam hält, weil sie immer wieder ihre eigenen Konzepte, Grundannahmen und Ableitungen hinterfragt).

Einen derartigen Versuch unternehmen zwei Forscherinnen: Claudia Aradau und Mercedes Bunz. Sie haben einen lesenswerten Essay geschrieben (in englischer Sprache), der frei im Netz verfügbar ist. Titel: "Dismantling the apparatus of domination? Left critiques of AI" (zu Deutsch: "Demontage des Herrschaftsapparats? Linke Kritik an KI"). Hier steht KI (also künstliche Intelligenz) für selbstlernende und (semi-)autonome Algorithmen.

Ihr Ausgangspunkt ist die Instrumentalisierung von KI im militärisch-industriellen Komplex. KI im Drohnenkrieg. KI im Cyberwar. KI im intelligenten Helm des Hightech-Soldaten. Kein Wunder: Forscher*innen und Programmierer*innen begehren auf. Frei nach dem Motto: "Wir wollen nicht, dass unsere Arbeit für das industriell automatisierte Massenmorden missbraucht wird." Mehr noch: "Wir wollen nicht weiter dabei zusehen, wie die unsichtbar gemachte (und häufig unbezahlte) Arbeit von Menschen, die bei der Entwicklung von KI erforderlich ist, dabei weiter instrumentalisiert wird."

Nun kritisieren Claudia Aradau und Mercedes Bunz die kategorische Ablehnung von KI, die sich daraus in mancher linker Algorithmuskritik ergibt. Und sie verweisen auf alternative, aktivistische Projekte wie VFRAME, die eine andere Welt im Zeichen von KI stark machen.

Sie schreiben:

Das Open-Source-Computer-Vision-Projekt VFRAME wurde entwickelt, um die Menschenrechtsforschung zu unterstützen. Es arbeitet derzeit mit einem Archiv digitaler Informationen aus Konfliktgebieten, das von der NRO Mnemonic betrieben wird. Mnemonic widmet sich der Sammlung und Bewahrung digitaler Informationen aus Konfliktgebieten, damit diese in Kämpfen um Rechenschaftspflicht und Gerechtigkeit genutzt werden können. Syrien ist einer der Orte, an denen die Organisation die digitale Dokumentation von Menschenrechtsverletzungen, Kriegsgräueln und internationalen Verbrechen archiviert und aufbewahrt.

Und weiter:

Die Arbeit, die damit verbunden ist, ist aufwendig. Dazu kann es gehören, das KI-Modell durch Tausende von Videos laufen zu lassen, um Beispielmunition zu finden, und diese dann manuell durchzugehen, um diejenigen zu finden, die für Testdaten geeignet sein könnten, und diese auszusortieren. Die gefundenen Bilder, die von hoher Qualität sind, werden auf eine Kommentierungsplattform gestellt. Mitarbeiter und Freunde machen sich dann an die Arbeit, exakte Kästen um sie herum zu zeichnen, damit der Algorithmus erkennen und lernen kann, was er sich ansehen soll - hier ist die Datenbereinigung eine kollektive Leistung. Die neu bereinigten Daten werden dann wieder in die Benchmarking-Daten des Projekts eingefügt, um die auf synthetischen Daten trainierten Modelle zu bewerten. Über viele Iterationen lernt der KI-Algorithmus, die Munition immer besser zu erkennen.

So kommen Claudia Aradau und Mercedes Bunz zu dem folgenden Schluss:

Interventionen von Aktivisten wie VFRAME zeigen, dass es möglich ist, KI als subversive Technik und kritische technische Praxis zu begreifen, die das Feld in Richtung einer anderen Politik der KI bewegt. Anstelle der Wiederholung von Zukunftsszenarien der KI-Katastrophe, die die Macht von Fachleuten verfestigen, die die Grenzen zwischen Mensch und Maschine, Militär und Wissenschaft, Produktion und Zerstörung bewahren können, entsteht eine andere Politik der KI an den Schnittstellen von politischen Kämpfen über Grenzen hinweg, Bemühungen um die Organisation und Entwicklung gemeinsamer Infrastrukturen abseits von Technologiekonzernen und kollektiven Beiträgen zu Daten. Diese KI-Politik greift in die kapitalistische Gewalt ein, indem sie eine subversive Arbeit in der Gegenwart verrichtet und Formen der zeitgenössischen Herrschaft demontiert.

Diese Arbeit der Subversion, die die Ambivalenz der Technik mobilisiert, bedeutet nicht, dass wir aufhören sollten, über KI-gestützte Waffen zu diskutieren. Vielmehr bedeutet es, um auf den Brief der deutschen Wissenschaftler zurückzukommen, mit dem wir begonnen haben, dass linke Analysen von KI Macht, Arbeit und Herrschaft zusammenhalten müssen. KI-gestützte Waffen materialisieren die zerstörerische Produktivität der KI. Sie leben von der Arbeit unbezahlter, unterbezahlter und vertriebener Menschen auf der ganzen Welt und verschärfen die Hierarchien der Menschheit. Beispiele wie VFRAME zeigen, dass eine andere KI, die den kapitalistischen ideologischen Rahmen durchbricht und vom Elend lebt, sich im Hier und Jetzt entfaltet.

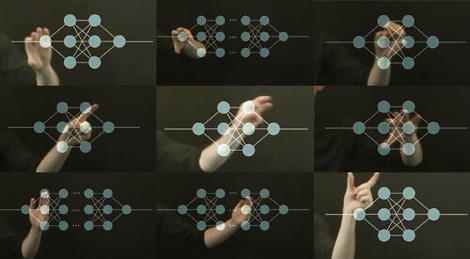

Quelle: Claudia Aradau und Mercedes Bunz Bild: Radical Philosophy EN www.radicalphilosophy.com

Bleib immer informiert! Hier gibt's den Kanal Technologie und Gesellschaft als Newsletter.

Einfach die Hörempfehlungen unserer KuratorInnen als Feed in deinem Podcatcher abonnieren. Fertig ist das Ohrenglück!

Öffne deinen Podcast Feed in AntennaPod:

Wenn alles geklappt hat,

kannst du das Fenster schließen.

Öffne deinen Podcast Feed in Apple Podcasts:

Wenn alles geklappt hat,

kannst du das Fenster schließen.

Öffne deinen Podcast Feed in Downcast:

Wenn alles geklappt hat,

kannst du das Fenster schließen.

Öffne deinen Podcast Feed in Instacast:

Wenn alles geklappt hat,

kannst du das Fenster schließen.

Öffne deinen Podcast Feed in Apple Podcasts:

Wenn alles geklappt hat,

kannst du das Fenster schließen.

Öffne deinen Podcast Feed in Podgrasp:

Wenn alles geklappt hat,

kannst du das Fenster schließen.

Bitte kopiere die URL und füge sie in deine

Podcast- oder RSS-APP ein.

Wenn du fertig bist,

kannst du das Fenster schließen.

Öffne deinen Podcast Feed in gpodder.net:

Wenn alles geklappt hat,

kannst du das Fenster schließen.

Öffne deinen Podcast Feed in Pocket Casts:

Wenn alles geklappt hat,

kannst du das Fenster schließen.